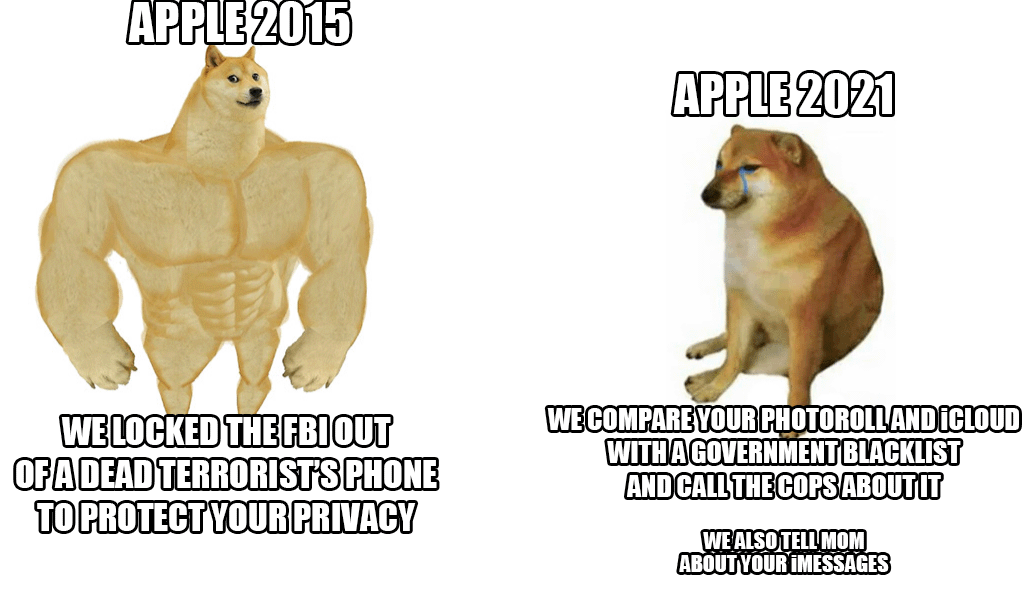

Sa huling bahagi ng nakaraang linggo, inilabas ng Apple ang isang bagong sistema ng pag-aabuso sa mga bata na mag-i-scan ng halos lahat ng mga larawan sa iCloud. Bagama't mukhang maganda ang ideya sa unang tingin, dahil kailangan talagang protektahan ang mga bata mula sa pagkilos na ito, ang higanteng Cupertino ay binatikos pa rin ng isang avalanche - hindi lamang mula sa mga user at eksperto sa seguridad, kundi pati na rin sa hanay ng mga empleyado mismo.

Ayon sa pinakabagong impormasyon mula sa isang respetadong ahensya Reuters ilang empleyado ang nagpahayag ng kanilang mga alalahanin tungkol sa sistemang ito sa isang panloob na komunikasyon sa Slack. Diumano, dapat silang matakot sa posibleng pang-aabuso ng mga awtoridad at gobyerno, na maaaring abusuhin ang mga posibilidad na ito, halimbawa, upang i-censor ang mga tao o mga piling grupo. Ang paghahayag ng system ay nagdulot ng matinding debate, na mayroon nang mahigit 800 indibidwal na mensahe sa loob ng nabanggit na Slack. Sa madaling salita, nag-aalala ang mga empleyado. Maging ang mga dalubhasa sa seguridad ay dati nang nagbigay-pansin sa katotohanan na sa maling mga kamay ito ay magiging isang talagang mapanganib na sandata na ginagamit upang sugpuin ang mga aktibista, ang kanilang nabanggit na censorship at iba pa.

Ang magandang balita (sa ngayon) ay ang bagong bagay ay magsisimula lamang sa Estados Unidos. Sa ngayon, hindi pa malinaw kung ang sistema ay gagamitin din sa loob ng mga estado ng European Union. Gayunpaman, sa kabila ng lahat ng mga pagpuna, ang Apple ay nakatayo sa kanyang sarili at ipinagtatanggol ang system. Pinagtatalunan niya higit sa lahat na ang lahat ng pagsusuri ay nagaganap sa loob ng device at kapag may tugma, pagkatapos lamang sa sandaling iyon ang kaso ay muling sinusuri ng isang empleyado ng Apple. Sa kanyang pagpapasya lamang ito ibibigay sa mga kinauukulang awtoridad.

Maaaring ito ay interesado ka

Ayaw kong lumipat mula sa iCloud sa isang bagay na ligtas at tunay na pribado, ngunit kung igiit ng Apple, hihinto pa rin ako sa pagbabayad sa kanila.

Ito ay magiging aktibo (sa ngayon) lamang sa US

Hindi mahalaga kung saan ito ilalapat sa batas. Lalabas na ang teknolohiyang iyon at ipapakalat. Iyan ang pinakamalaking panganib.